인공지능,딥러닝,머신러닝 기초

ANN

풍요 평화 만땅 연구원

2022. 7. 18. 17:16

- 완벽한 퍼즐이 되어가는 과정

=> 비선형 변환이 여러번 일어나야함

- 미분 가능하지 않으면 -> 학습 불가능 -> Sigmoid 함수를 이용하여 미분가능하게 함

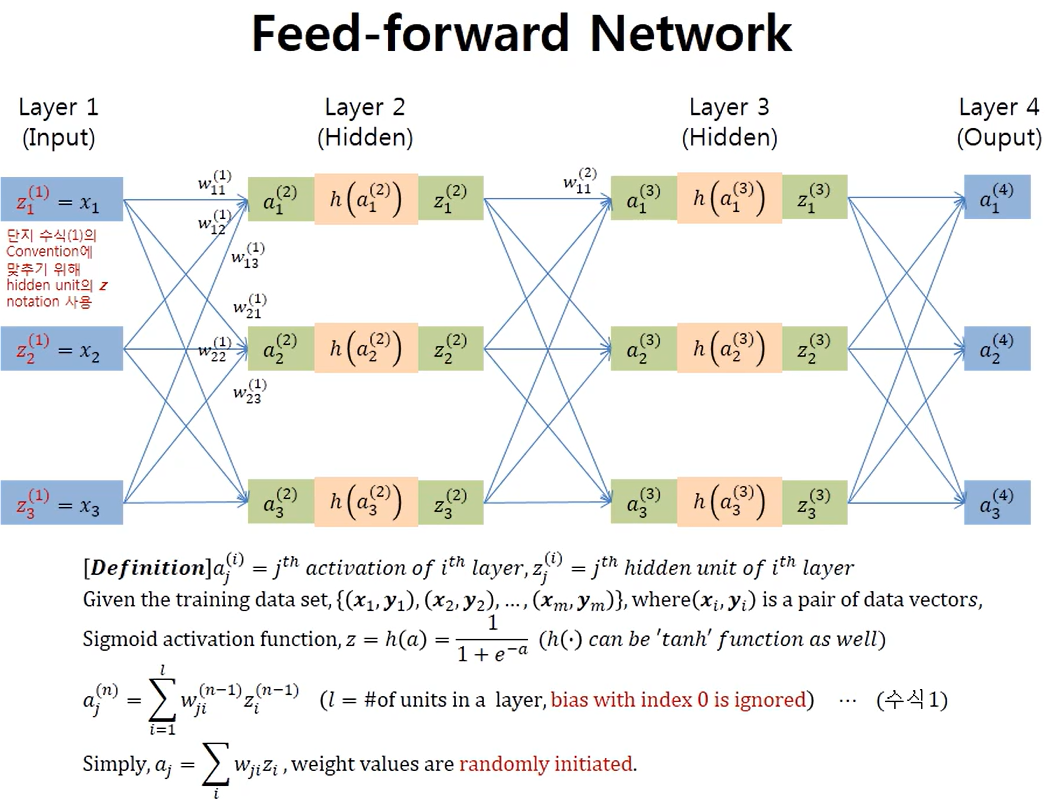

- Feed-forwarding : 그림처럼 ANN모델은 왼쪽(input)에서 오른쪽(output)으로 한쪽 방향으로 흐름이 진행되는 특성을 갖고 있다.

- 'Input layer + 최소 1개이상의 hidden layer + output layer' 로 구성됨

- 이 때 hidden-layer가 많아질수록 'Deep'하다고 하며 결국 Deep하게 되면 우리가 흔히 알고 있는 '딥러닝' 모델이라고 부를 수 있음 => 현재 이론상으로 hidden-layer이 많을수록 모델의 성능이 좋음을 가정하고 있음

- hidden-layer의 특징 : input값들을 집약해주는 역할을 함 => 이 hidden-layer이 많아지고 오른쪽으로(output쪽으로) 흐름이 진행될수록 더 고도화된 정보를 갖게 됨.(image로 치면 더 상위의 개념으로 가게 된다 ex. 선->도형->...)

- Bi-partitie graph(이분 그래프) : 그림속 분홍색 선을 본다면 각 Layer들끼리 모두 연결(full-connected)되어있지만 같은 Layer의 노드(각 perceptron=neuron)끼리는 서로 독립적

- 각 Layer의 초록색으로 칠해진 동그라미 부분은 Bias값

- w값들이 sum되서 a에 들어가고 a이 활성화 함수 h(sigmoid activation function)을 통과 하여 output으로 z(hidden unit) 생김

- 전방향으로 전파되는 방식

- x,y사이 관계가 hidden layer로 묘사되는 것(어떤 w값들이 있어야 y 되는지 훈련해주는 것)

- 초기 w값들은 렌덤하게 초기화 시킴(임의로 초기화됨)

- 첫번째 layer에서 발생한 error가 다음 layer로 propagation됨

- 최종 error 값이 마지막 레이어에서 산출

*참고 : https://techblog-history-younghunjo1.tistory.com/73

[ML] ANN(Artificial Neural Network) 인공신경망

※해당 게시물에 사용된 일부 자료는 순천향대학교 빅데이터공학과 정영섭 교수님의 머신러닝 전공수업 자료에 기반하였음을 알려드립니다. 이번 포스팅에서는 저번 포스팅에서 다루었던 주

techblog-history-younghunjo1.tistory.com